Die Technologie zur Gesichtserkennung gibt es schon seit geraumer Zeit, doch bis vor kurzem war die Gesichtsanalyse für die meisten Zwecke nicht genau genug. Mittlerweile scheint es überall Gesichtserkennung zu geben:

Der Grund, warum Gesichtserkennungssoftware in letzter Zeit viel besser und schneller geworden ist, ist das Aufkommen des Deep Learning: leistungsfähigere und parallelisierte Computer sowie ein besseres Softwaredesign. Ich werde darüber sprechen, was sich geändert hat.

Die ersten ernsthaften Versuche, einen Gesichtserkenner zu bauen, fanden in den 1980er und 1990er Jahren statt und nutzten sogenannte Eigenfaces . Ein Eigenface ist ein verschwommenes, gesichtsähnliches Bild, und ein Gesichtserkenner geht davon aus, dass jedes Gesicht aus vielen dieser Bilder besteht, die Pixel für Pixel übereinander gelegt sind.

Wenn wir ein unbekanntes Gesicht erkennen möchten, müssen wir lediglich herausfinden, aus welchen Eigengesichtern es wahrscheinlich besteht. Wenig überraschend funktionierte die Eigenface-Methode nicht besonders gut. Wenn man ein Gesichtsbild ein paar Pixel nach rechts oder links verschiebt, erkennt man schnell, dass diese Methode fehlschlägt, da die Gesichtsteile nicht mehr mit dem Eigenface übereinstimmen.

Fast Data Science - London

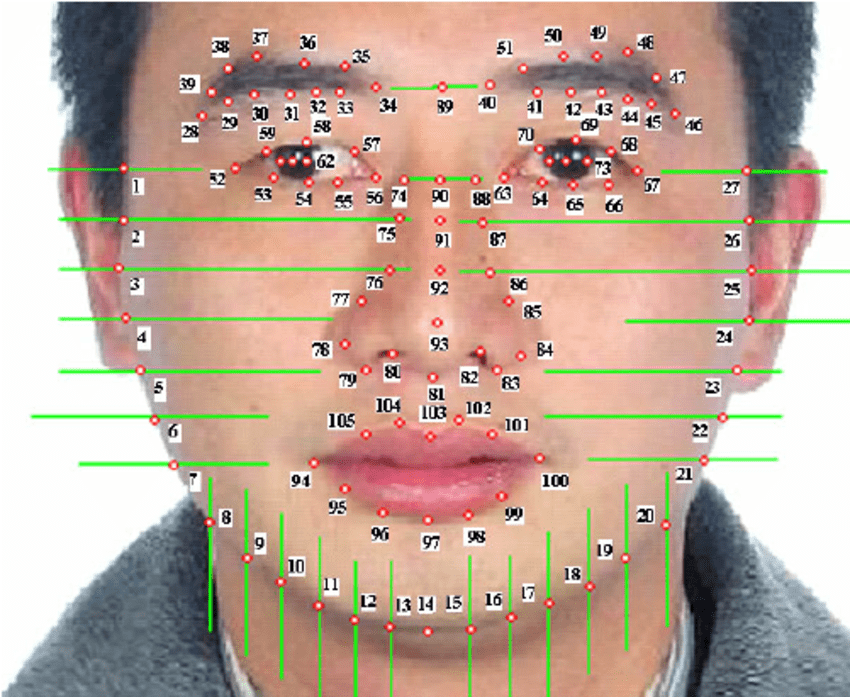

Die nächste Generation von Gesichtserkennern würde jedes Gesichtsbild aufnehmen und wichtige Punkte wie den Mundwinkel oder eine Augenbraue finden. Die Koordinaten dieser Punkte werden Gesichtsmerkmalspunkte genannt. Ein bekanntes kommerzielles Programm wandelt jedes Gesicht in 66 Merkmalspunkte um.

Gesichtsmerkmalpunkte, eine handcodierte Methode der Gesichtserkennungstechnologie. Bildquelle

Um zwei Gesichter zu vergleichen, vergleichen Sie einfach die Koordinaten (nach Anpassung, falls ein Bild leicht von der Ausrichtung abweicht).

Es überrascht nicht, dass die Methode der Gesichtsmerkmalkoordinaten besser ist als die Eigenfaces-Methode, aber immer noch suboptimal. Wir werfen viele nützliche Informationen weg: Haarfarbe, Augenfarbe, jede Gesichtsstruktur, die nicht durch einen Merkmalspunkt erfasst wird, usw.

Insbesondere bei der letzten Methode zur Gesichtsanalyse musste ein Mensch einem Computer die Definition einer „Augenbraue“ usw. programmieren. Die aktuelle Generation der Gesichtserkennungsmodelle mit maschinellem Lernen wirft dies alles über den Haufen.

Bei diesem Ansatz kommen Convolutional Neural Networks (CNNs) zum Einsatz. Dabei wird eine Art Schablone wiederholt über das Bild geführt und es wird herausgefunden, wo Teilbereiche des Bildes bestimmten Mustern entsprechen.

Beim ersten Mal nimmst du Ecken und Kanten auf. Nachdem du dies fünfmal gemacht hast, beginnst du jedes Mal auf der Ausgabe des vorherigen Durchlaufs, Teile eines Auges oder Ohrs aufzunehmen. Nach 30 Mal hast du ein ganzes Gesicht erkannt!

Der Clou dabei ist, dass die gesuchten Muster noch nicht von jemandem definiert wurden, sondern dass sie vielmehr aus dem Training des Netzwerks mit Millionen von Gesichtsbildern stammen.

Natürlich kann dies eine Achillesferse des CNN-Ansatzes sein, da Sie möglicherweise keine Ahnung haben, warum ein Gesichtserkenner eine bestimmte Antwort gegeben hat.

Wenn Sie Ihren eigenen Gesichtserkenner für CNN entwickeln möchten, müssen Sie sich die Frage stellen, wo Sie Millionen von Bildern für die Entwicklung des Modells herbekommen können. Viele Leute suchen sich dafür Bilder von Prominenten aus dem Internet.

Sie können jedoch viel mehr Bilder erhalten, wenn Sie die Leute dazu bringen können, Ihnen ihre persönlichen Fotos kostenlos zu überlassen!

Aus diesem Grund verfügen Facebook, Microsoft und Google über einige der genauesten Gesichtserkenner, da sie Zugriff auf die erforderlichen Ressourcen haben, um die maschinellen Lernmodelle für die Gesichtserkennung zu trainieren.

Der CNN-Ansatz ist alles andere als perfekt und viele Unternehmen nehmen zusätzlich zu dem von mir beschriebenen Ansatz noch einige Anpassungen vor, um die Einschränkungen auszugleichen. Dazu gehören beispielsweise Korrekturen hinsichtlich Körperhaltung und Beleuchtung, häufig unter Verwendung eines 3D-Mesh-Modells des Gesichts.

Gesichtserkennungsmodelle auf der Basis maschinellen Lernens entwickeln sich rasch weiter und jedes Jahr bringt der Stand der Technik im Bereich der Gesichtserkennung und -analyse spürbare Verbesserungen.

Wenn Sie mehr über dieses Feld oder ähnliche Projekte erfahren möchten oder im Jahr 2024 Geschäftsanwendungen von Gesichtserkennungsmodellen auf der Basis maschinellen Lernens implementieren möchten, nehmen Sie bitte Kontakt mit uns auf .

Entfesseln Sie das Potenzial Ihrer NLP-Projekte mit dem richtigen Talent. Veröffentlichen Sie Ihre Stelle bei uns und ziehen Sie Kandidaten an, die genauso leidenschaftlich über natürliche Sprachverarbeitung sind.

NLP-Experten einstellen

Generative KI Einführung Generative KI , ein Teilbereich der KI, verändert Branchen grundlegend und gestaltet die Zukunft. Durch die Nutzung fortschrittlicher Algorithmen kann generative KI Inhalte, Designs und Lösungen erstellen, die zuvor undenkbar waren. Durch die Verwendung von Modellen des maschinellen Lernens wie Generative Adversarial Networks (GANs) und Variational Autoencoders (VAEs) können generative KI-Systeme neue Daten erstellen, die die Muster und Strukturen der Trainingsdaten nachahmen.

Große Daten Das Aufkommen von Big Data hat ganze Branchen revolutioniert und traditionelle Geschäftsmodelle und Entscheidungsprozesse verändert. In dieser umfassenden Untersuchung gehen wir der Frage nach, was Big Data ist, welche erheblichen Auswirkungen es auf die Geschäftsstrategie hat und wie Unternehmen riesige Datenmengen nutzen können, um Innovationen voranzutreiben und sich einen Wettbewerbsvorteil zu verschaffen.

KI im Finanzwesen Die Integration künstlicher Intelligenz (KI) in den Finanzsektor hat die Arbeitsweise von Institutionen revolutioniert, von der Automatisierung von Abläufen bis hin zur Verbesserung der Kundenbindung und des Risikomanagements. Diese umfassende Untersuchung wird mehrere Schlüsselbereiche untersuchen, in denen KI in der Branche erhebliche Fortschritte macht.

What we can do for you