KI im Gesundheitswesen vereinfacht das Leben von Patienten und Ärzten , da Routineaufgaben präziser und in kürzerer Zeit erledigt werden können.

Im medizinischen Bereich spielt künstliche Intelligenz zweifellos eine immer wichtigere Rolle bei der Vereinfachung des Lebens von Krankenhausverwaltern, Ärzten und Patienten. KI wird im Gesundheitswesen mittlerweile eingesetzt, um Aufgaben, die normalerweise von Menschen ausgeführt werden, viel schneller und zu wesentlich geringeren Kosten zu erledigen.

Es gibt bereits zahlreiche Möglichkeiten, wie maschinelles Lernen und KI im Gesundheitswesen genutzt werden. Eine der wichtigsten ist jedoch die Krankheitsdiagnose . Im Jahr 2018 wurde ein Bericht veröffentlicht, der zeigte , dass in Großbritannien schockierende 40 % der Krebspatienten zunächst falsch diagnostiziert wurden . Kein Wunder also, dass die Verbesserung diagnostischer Prozesse eine der spannendsten Anwendungen für Deep Learning im Gesundheitswesen ist.

Hohe Fallzahlen und unvollständige Krankengeschichten können zu tödlichen menschlichen Fehlern führen. KI ist immun gegen solche Variablen und kann daher Krankheiten viel schneller diagnostizieren und vorhersagen als Ärzte. Als Beispiel für die positiven Auswirkungen in der Praxis hat eine aktuelle Studie gezeigt, dass mithilfe eines künstlichen Intelligenzmodells, das die Leistungsfähigkeit von Deep Learning und Algorithmen nutzt , Brustkrebsfälle effektiver diagnostiziert werden konnten als durch erfahrene Pathologen.

Künstliche Intelligenz kam im Gesundheitswesen erstmals in den 1960er und 1970er Jahren zum Einsatz, als Dendral , das ursprüngliche Expertensystem bzw. Problemlösungsprogramm, entwickelt wurde. Es wurde für Anwendungen in der organischen Chemie konzipiert und bildete die Grundlage für die Entwicklung des MYCIN-Systems – eine Anwendung, die allgemein als eine der wichtigsten frühen Anwendungen von KI im Gesundheitswesen gilt. In den 1980er und 1990er Jahren verbreitete sich der Mikrocomputer und brachte ein völlig neues Niveau der Netzwerkkonnektivität mit sich. Entwickler und Forscher erkannten allmählich, dass KI-Gesundheitssysteme so konzipiert werden konnten, dass sie auf der Expertise der Ärzte aufbauten und gleichzeitig den Mangel an perfekten Daten ausglichen.

Seit den 1990er Jahren haben sich die technologischen und medizinischen Fortschritte noch weiter ausgeweitet und maschinelles Lernen ist heute im Gesundheitssektor fest verankert. Dies ist einer Vielzahl von Entwicklungen zu verdanken, darunter schnellere Datenverarbeitung und -erfassung dank verbesserter Computerleistung, das Wachstum von Datenbanken mit Genomsequenzen, die weitverbreitete Einführung elektronischer Gesundheitsakten und Verbesserungen in den Bereichen Computer Vision und Verarbeitung natürlicher Sprache .

Die KI wird von Jahr zu Jahr ausgefeilter. Das bedeutet, dass das Potenzial für Deep Learning im Gesundheitssektor enorm ist. Maschinelles Lernen ist bereits zu einem Schlüsselelement im modernen Ökosystem des Gesundheitswesens geworden und verändert viele verschiedene Aspekte der Branche, darunter Krankheitsprävention, Diagnose , Forschung und Behandlung.

Fast Data Science - London

Der Weg vom Forschungslabor zum Patienten ist teuer und langwierig. Neue Medikamente brauchen rund 12 Jahre, um diesen Prozess zu durchlaufen , und nur 5 von 5.000 Medikamenten, die in der präklinischen Prüfung beginnen, erreichen jemals die Testphase am Menschen. Und nicht nur das: Nur ein einziges dieser fünf Medikamente wird jemals zur Anwendung zugelassen. Wenn man bedenkt, dass die Kosten hierfür mehr als 1,2 Milliarden Pfund pro Medikament betragen, ist es leicht zu erkennen, warum die Arzneimittelentdeckung und -forschung eine der wichtigsten Anwendungen für künstliche Intelligenz in diesem Sektor ist. Die neuesten KI-Fortschritte zielen nun darauf ab, den Prozess der Entdeckung und Neuverwendung von Medikamenten zu rationalisieren, da sie das Potenzial haben, die Markteinführungszeit und die Kosten neuer Medikamente erheblich zu verkürzen.

Der vielleicht größte Nutzen künstlicher Intelligenz im medizinischen Bereich besteht darin, dass sie der Bevölkerung hilft, gesund zu bleiben, sodass sie seltener zum Arzt gehen muss. Das IoMT (Internet of Medical Things) und die KI in Gesundheits-Apps für Verbraucher helfen den Menschen bereits. Technologie-Apps ermutigen Menschen, sich gesünder zu verhalten, und unterstützen sie dabei, proaktiv einen gesünderen Lebensstil zu pflegen. Ihr Zweck besteht darin, der Bevölkerung mehr Kontrolle über ihr eigenes Wohlbefinden zu geben.

KI ermöglicht es dem medizinischen Fachpersonal außerdem, ein tieferes Verständnis für die Bedürfnisse und den Alltag der Patienten zu entwickeln, die sie betreuen. Mit diesem Verständnis können sie ihren Patienten dann bessere Unterstützung, Anleitung und Feedback geben, damit sie langfristig gesund bleiben.

Die heutige Begeisterung für die aufkeimende KI-Technologie rührt zum großen Teil von der weitverbreiteten Überzeugung her, dass sie zahlreiche Aspekte des medizinischen Sektors revolutionieren könnte, von der Entwicklung moderner medizinischer Geräte bis hin zur Bereitstellung von Präzisionsmedizin für eine bessere Versorgung von Risikogruppen . Allerdings sind auch einige potenzielle Nachteile zu bedenken.

Zu den Vorteilen der künstlichen Intelligenz im Gesundheitswesen gehören:

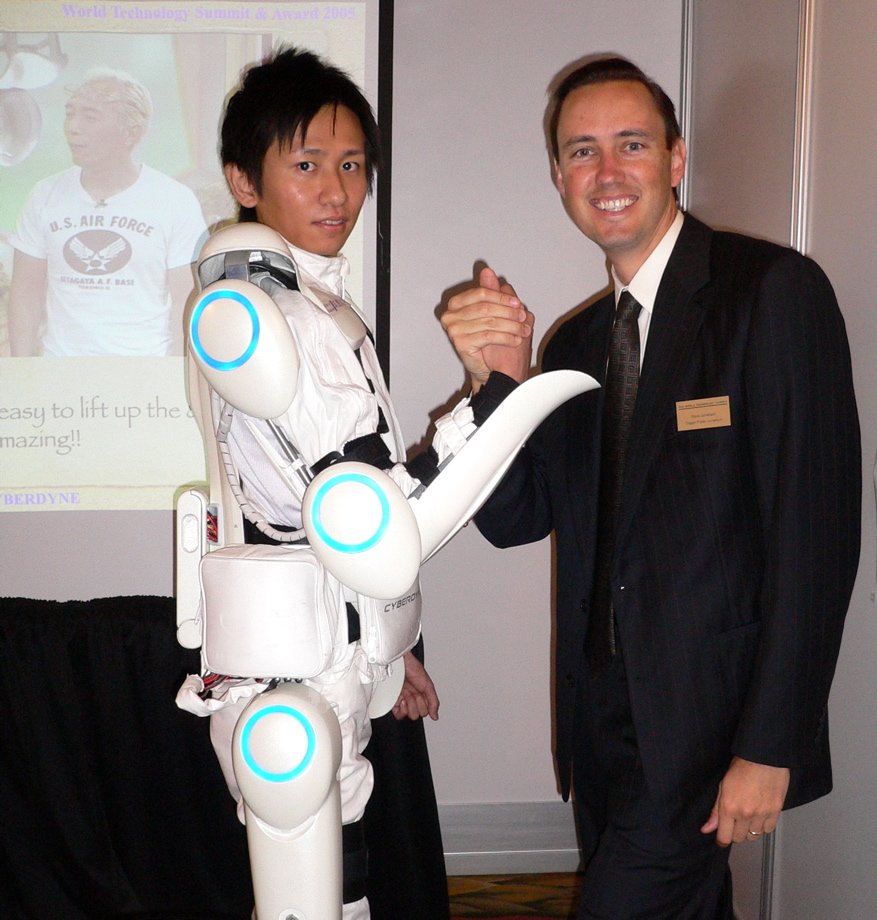

Ein Beispiel für KI im Gesundheitswesen. Ein elektronisches Exoskelett, das von der Tsukuba University of Japan entwickelt wurde. Bildquelle: Wikimedia Commons

Der Einsatz von KI im medizinischen Bereich bringt jedoch auch einige Nachteile mit sich:

Wohin kann KI die Gesundheitsbranche in Zukunft führen? Das ist eine wichtige Frage, und obwohl niemand die genaue Antwort kennt, wird sie mit Sicherheit bahnbrechende Veränderungen mit sich bringen. Künstliche Intelligenz soll sicherstellen, dass durch fortschrittlichere Behandlungen und genauere Krankheitsdiagnosen bessere medizinische Ergebnisse für Patienten erzielt werden können. KI wird Patienten dabei helfen, sich stärker zu engagieren und besser über ihr eigenes Wohlbefinden und ihre Gesundheit informiert zu sein, sodass sie besser für sich selbst sorgen und länger gesund bleiben können.

KI wird auch die Effizienz von Verwaltungsabläufen verbessern, sodass Krankenhausverwalter Kosten und Zeit für die Durchführung ihrer Operationen reduzieren können. Mit vernetzten Krankenhäusern und einer stärker vernetzten Versorgung dank einer einzigen digitalen Infrastruktur und zentralisierten Kommandozentralen wird es möglich, Systemengpässe zu beseitigen und medizinisches Fachpersonal dorthin zu leiten, wo es am dringendsten benötigt wird. Dadurch wird sowohl für Patienten als auch für Personal insgesamt eine bessere Erfahrung erzielt. Wartezeiten werden verkürzt, die Arbeitsabläufe des Personals verbessert und der Verwaltungsaufwand verringert.

Es gibt zahlreiche Informationen zu den aktuellen Anwendungen künstlicher Intelligenz und maschinellen Lernens im Gesundheitssektor und jede Menge hilfreiche Artikel zu den damit verbundenen Vor- und Nachteilen.

Wenn Sie mehr über die heutige Nutzung von Deep Learning erfahren möchten oder wissen möchten, wie es in Zukunft nutzbringend eingesetzt werden kann, können Sie den Artikel des Royal College of Physicians über das Potenzial künstlicher Intelligenz im Gesundheitswesen und diesen Artikel von Forbes über die drei Arten, wie künstliche Intelligenz das Gesundheitswesen verändern wird, lesen. Dies sind nur zwei der vielen hilfreichen Artikel, die heute online sind und Ihnen einen tieferen Einblick in die faszinierende und nutzbringende Entwicklung der Medizinbranche geben.

[1] Bejnordi, Veta, van Diest et al, Diagnostische Bewertung von Deep Learning-Algorithmen zur Erkennung von Lymphknotenmetastasen bei Frauen mit Brustkrebs (2017), JAMA Network

[2] Kriwet, Hier sind 3 Möglichkeiten, wie KI das Gesundheitswesen bis 2030 verändern wird (2020), Weltwirtschaftsforum

Entfesseln Sie das Potenzial Ihrer NLP-Projekte mit dem richtigen Talent. Veröffentlichen Sie Ihre Stelle bei uns und ziehen Sie Kandidaten an, die genauso leidenschaftlich über natürliche Sprachverarbeitung sind.

NLP-Experten einstellen

Generative KI Einführung Generative KI , ein Teilbereich der KI, verändert Branchen grundlegend und gestaltet die Zukunft. Durch die Nutzung fortschrittlicher Algorithmen kann generative KI Inhalte, Designs und Lösungen erstellen, die zuvor undenkbar waren. Durch die Verwendung von Modellen des maschinellen Lernens wie Generative Adversarial Networks (GANs) und Variational Autoencoders (VAEs) können generative KI-Systeme neue Daten erstellen, die die Muster und Strukturen der Trainingsdaten nachahmen.

Große Daten Das Aufkommen von Big Data hat ganze Branchen revolutioniert und traditionelle Geschäftsmodelle und Entscheidungsprozesse verändert. In dieser umfassenden Untersuchung gehen wir der Frage nach, was Big Data ist, welche erheblichen Auswirkungen es auf die Geschäftsstrategie hat und wie Unternehmen riesige Datenmengen nutzen können, um Innovationen voranzutreiben und sich einen Wettbewerbsvorteil zu verschaffen.

KI im Finanzwesen Die Integration künstlicher Intelligenz (KI) in den Finanzsektor hat die Arbeitsweise von Institutionen revolutioniert, von der Automatisierung von Abläufen bis hin zur Verbesserung der Kundenbindung und des Risikomanagements. Diese umfassende Untersuchung wird mehrere Schlüsselbereiche untersuchen, in denen KI in der Branche erhebliche Fortschritte macht.

What we can do for you