Bereit für den nächsten Schritt in Ihrer NLP-Reise? Vernetzen Sie sich mit Top-Arbeitgebern, die Talente in der natürlichen Sprachverarbeitung suchen. Entdecken Sie Ihren Traumjob!

Finden Sie Ihren TraumjobIn den letzten Wochen haben mehrere Apple-Card-Nutzer in den USA berichtet, dass ihnen und ihren Partnern trotz gleichem Einkommen und gleicher Kreditwürdigkeit sehr unterschiedliche Kreditlimits für die Markenkreditkarte zugewiesen wurden (siehe BBC-Artikel ). Steve Wozniak, ein Mitbegründer von Apple, twitterte, dass sein Kreditlimit auf der Karte zehnmal höher sei als das seiner Frau, obwohl das Paar auf allen anderen Karten das gleiche Kreditlimit habe.

Das Department of Financial Services in New York, eine Aufsichtsbehörde für Finanzdienstleistungen, untersucht Vorwürfe, dass das Geschlecht der Nutzer die Ursache für die Ungleichheit sein könnte. Apple möchte darauf hinweisen, dass Goldman Sachs für den Algorithmus verantwortlich ist, was offenbar im Widerspruch zu Apples Marketingslogan „Created by Apple, not a bank“ steht.

Da die Untersuchung der Aufsichtsbehörde noch andauert und noch keine Voreingenommenheit nachgewiesen werden konnte, schreibe ich in diesem Artikel nur Hypothesen.

Die Apple-Card-Geschichte ist nicht das einzige aktuelle Beispiel für algorithmische Voreingenommenheit, die Schlagzeilen macht. Im Juli letzten Jahres unterzeichnete die NAACP (National Association for the Advancement of Colored People) in den USA eine Erklärung, in der sie ein Moratorium für den Einsatz automatisierter Entscheidungstools forderte, da einige von ihnen nachweislich rassistisch voreingenommen sind, wenn sie zur Vorhersage verwendet werden Rückfall – mit anderen Worten, wie wahrscheinlich es ist, dass ein Täter erneut straffällig wird.

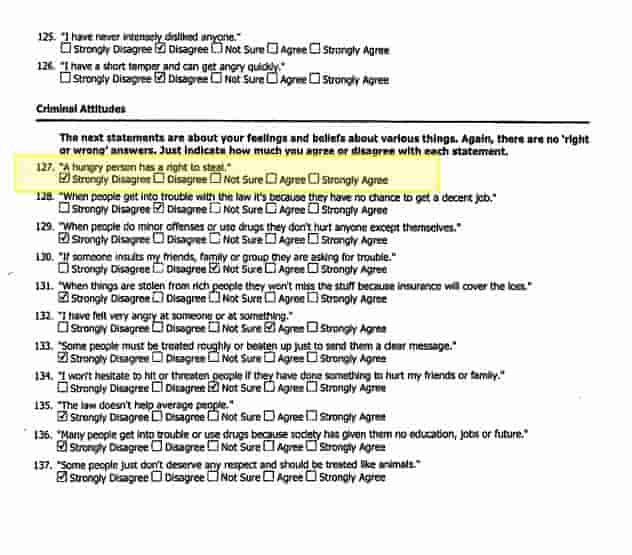

Im Jahr 2013 wurde Eric Loomis zu sechs Jahren Gefängnis verurteilt, nachdem der Bundesstaat Wisconsin ein Programm namens COMPAS verwendet hatte, um seine Wahrscheinlichkeit, ein weiteres Verbrechen zu begehen, zu berechnen. COMPAS ist ein proprietärer Algorithmus, dessen Innenleben nur seinem Anbieter Equivant bekannt ist. Loomis versuchte, die Verwendung des Algorithmus vor dem Obersten Gerichtshof von Wisconsin anzufechten, doch seine Anfechtung wurde letztendlich abgelehnt.

Ein Screenshot des Fragebogens, den ein Verdächtiger ausfüllt und den das COMPAS-Modell zur Vorhersage des Rückfallrisikos verwendet. Dem COMPAS-Modell wurde KI-Voreingenommenheit vorgeworfen. Bildquelle und vollständiges Dokument .

Leider verschlimmern Vorfälle wie diese nur die weit verbreitete Wahrnehmung von KI als gefährlichem, undurchsichtigem und unterreguliertem Werkzeug, das in der Lage ist, die schlimmsten Vorurteile der Gesellschaft zu verschlüsseln.

Ich werde mich hier auf das Beispiel eines Kreditantrags konzentrieren, da dieses Problem einfacher zu formulieren und zu analysieren ist, die von mir dargelegten Punkte jedoch auf jede Art von Voreingenommenheit und geschützte Kategorie verallgemeinerbar sind.

Ich möchte zunächst darauf hinweisen, dass ich stark bezweifle, dass sich irgendjemand bei Apple oder Goldman Sachs an die Arbeit gemacht und explizite Regeln geschaffen hat, die das Geschlecht bei Kreditentscheidungen berücksichtigen.

Stellen wir uns zunächst vor, dass wir ein maschinelles Lernmodell erstellen, das die Wahrscheinlichkeit eines Kreditausfalls einer Person vorhersagt. Es gibt eine Reihe „geschützter Kategorien“, wie zum Beispiel das Geschlecht, die wir nicht diskriminieren dürfen.

Das Entwickeln und Trainieren einer Kreditentscheidungs-KI ist ein „Vanilla“-Data-Science-Problem, das regelmäßig auf Kaggle (einer Website, auf der Sie an Data-Science-Wettbewerben teilnehmen können) auftaucht und zu dem angehende Datenwissenschaftler in Vorstellungsgesprächen befragt werden können. Das Rezept zur Herstellung eines Roboter- Kreditsachbearbeiters lautet wie folgt:

Stellen Sie sich vor, Sie haben eine große Tabelle mit 10.000 Zeilen rund um Kreditantragsteller, die Ihre Bank in der Vergangenheit gesehen hat:

| age | income | credit score | gender | education level | number of years at employer | job title | did they default? |

| 38 | 28000 | 460 | M | BSc | 2 | Nurse | No |

Fast Data Science - London

Die letzte Spalte ist das, was wir vorhersagen wollen.

Sie würden diese Daten nehmen und die Zeilen in drei Gruppen aufteilen, die als Trainingssatz, Validierungssatz und Testsatz bezeichnet werden.

Anschließend wählen Sie einen Algorithmus für maschinelles Lernen aus, beispielsweise „Lineare Regression“ , „Random Forest “ oder „Neural Networks“ , und lassen ihn aus den Trainingszeilen „lernen“, ohne dass er die Validierungszeilen sieht. Anschließend testen Sie es am Validierungssatz. Sie spülen und wiederholen den Vorgang für verschiedene Algorithmen und optimieren die Algorithmen jedes Mal, und das Modell, das Sie schließlich bereitstellen, ist dasjenige, das in Ihren Validierungszeilen die höchste Punktzahl erzielt hat.

Wenn Sie fertig sind, können Sie Ihr Modell anhand des Testdatensatzes testen und seine Leistung überprüfen.

Wenn nun die Spalte „Geschlecht“ in den Trainingsdaten vorhanden wäre, besteht natürlich die Gefahr, dass ein voreingenommenes Modell erstellt wird.

Allerdings haben die Datenwissenschaftler von Apple/Goldman diese Spalte wahrscheinlich von Anfang an aus ihrem Datensatz entfernt.

Wie kann es also sein, dass der digitale Geldverleiher immer noch geschlechtsspezifisch ist? Es gibt doch sicher keine Möglichkeit, dass unser Algorithmus sexistisch ist, oder? Schließlich kennt es nicht einmal das Geschlecht eines Bewerbers!

Unglücklicherweise und kontraintuitiv ist es immer noch möglich, dass sich Voreingenommenheit einschleicht!

Möglicherweise enthält unser Datensatz Informationen, die ein Indikator für das Geschlecht sind. Zum Beispiel: Beschäftigungsdauer, Gehalt und insbesondere Berufsbezeichnung könnten alle damit zusammenhängen, dass es sich bei unserem Bewerber um einen Mann oder eine Frau handelt.

Wenn es möglich ist, ein maschinelles Lernmodell auf Ihrem bereinigten Datensatz zu trainieren, um das Geschlecht mit einiger Genauigkeit vorherzusagen, dann besteht die Gefahr, dass Ihr Modell versehentlich geschlechtsspezifisch ist. Ihr Kreditvorhersagemodell könnte lernen, die impliziten Hinweise zum Geschlecht im Datensatz zu verwenden, auch wenn es das Geschlecht selbst nicht erkennen kann.

Ich möchte eine Ergänzung zum Arbeitsablauf der KI-Entwicklung vorschlagen: Wir sollten unsere KI aus verschiedenen Blickwinkeln angreifen und versuchen, mögliche Voreingenommenheiten aufzudecken, bevor wir sie einsetzen.

Es reicht nicht aus, nur die geschützten Kategorien aus Ihrem Datensatz zu entfernen, sich die Hände abzustauben und zu denken, „die Arbeit ist erledigt“.

Wir müssen auch den Advokaten des Teufels spielen, wenn wir eine KI entwickeln, und anstatt nur zu versuchen, die Ursachen von Voreingenommenheit zu beseitigen, sollten wir versuchen , das Vorhandensein von Voreingenommenheit nachzuweisen .

Wenn Sie sich auf dem Gebiet der Cybersicherheit auskennen, dann haben Sie sicher schon vom Konzept eines Pentests oder Penetrationstests gehört. Eine Person, die nicht an der Entwicklung Ihres Systems beteiligt war, beispielsweise ein externer Berater , versucht, Ihr System zu hacken, um Schwachstellen zu entdecken.

Ich schlage vor, dass wir KI-Pentests einführen sollten: eine Analogie zum Pentest zur Aufdeckung und Beseitigung von KI-Voreingenommenheiten :

Um eine KI auf Voreingenommenheit zu testen, würde entweder eine externe Person oder ein interner Datenwissenschaftler, der nicht an der Algorithmusentwicklung beteiligt war, versuchen, ein Vorhersagemodell zu erstellen, um die entfernten geschützten Kategorien zu rekonstruieren.

Zurück zum Kreditbeispiel: Wenn Sie das Geschlecht aus Ihrem Datensatz entfernt haben, würde der Penetrationstester sein Bestes geben, um ein Vorhersagemodell zu erstellen, um es zurückzusetzen. Vielleicht sollten Sie ihnen einen Bonus zahlen, wenn es ihnen gelingt, das Geschlecht einigermaßen genau zu rekonstruieren, was den Betrag widerspiegelt, den Sie andernfalls für die Schadensbegrenzung ausgegeben hätten, wenn Sie unabsichtlich ein sexistisches Kreditprognosemodell geliefert hätten.

Zusätzlich zum obigen Pen-Test schlage ich folgende weitere Prüfungen vor:

Segmentieren Sie die Daten nach Geschlechtern. Bewerten Sie die Genauigkeit des Modells für jedes Geschlecht.

Identifizieren Sie die Tendenz, die Ausfallwahrscheinlichkeit bei beiden Geschlechtern zu hoch oder zu niedrig einzuschätzen

Identifizieren Sie etwaige Unterschiede in der Modellgenauigkeit nach Geschlecht.

Einige der offensichtlicheren Ursachen der KI-Voreingenommenheit habe ich nicht behandelt. Beispielsweise ist es möglich, dass die Trainingsdaten selbst verzerrt sind. Dies ist bei einigen im Strafrechtssystem verwendeten Algorithmen höchstwahrscheinlich der Fall.

Nehmen wir an, Sie haben herausgefunden, dass der von Ihnen trainierte Algorithmus tatsächlich eine Voreingenommenheit für eine geschützte Kategorie wie das Geschlecht aufweist. Ihre Möglichkeiten, dies zu mildern, sind:

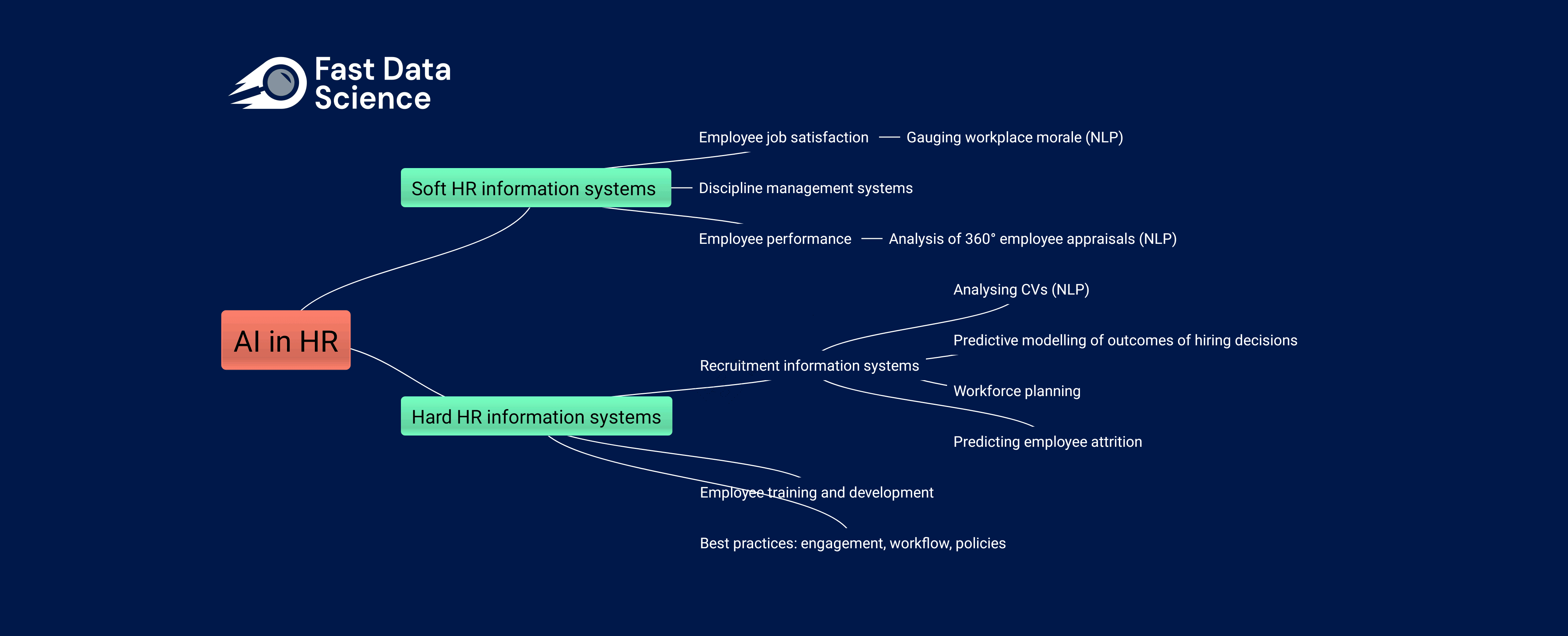

Eine Anwendung dieses Ansatzes, die ich gerne weiter untersuchen würde, ist die Beseitigung von Voreingenommenheit, wenn Sie maschinelles Lernen für die Personalbeschaffung nutzen. Stellen Sie sich vor, Sie hätten einen Algorithmus, der Lebensläufe den Stellen zuordnet. Wenn es versehentlich Lücken in den Lebensläufen von Personen entdeckt, die mit dem Mutterschaftsurlaub und damit dem Geschlecht übereinstimmen, besteht die Gefahr einer diskriminierenden KI. Ich kann mir vorstellen, dass dies durch einige der oben genannten Vorschläge ausgeglichen werden könnte, beispielsweise durch die Optimierung der Trainingsdaten und die künstliche Entfernung dieser Art von Signalen. Ich denke, dass der Pen-Test ein wirkungsvolles Werkzeug für diese Herausforderung wäre.

Heutzutage sind sich große Unternehmen der Gefahr bewusst, dass schlechte PR viral gehen kann. Wenn also der Apple Card-Algorithmus tatsächlich voreingenommen ist, wundert es mich, dass niemand den Algorithmus vor der Auslieferung gründlicher überprüft hat.

Eine Abweichung des Kreditlimits um den Faktor 10 je nach Geschlecht ist ein gravierender Fehler.

Hätten die Datenwissenschaftler, die am Kreditalgorithmus beteiligt waren, oder tatsächlich am vom Staat Wisconsin verwendeten Algorithmus zur Rückfallvorhersage, meine obige Checkliste für Penetrationstests und Stresstests ihrer Algorithmen befolgt, ich kann mir vorstellen, dass sie die PR-Katastrophe bemerkt hätten, bevor sie passierte Chance, Schlagzeilen zu machen.

Natürlich ist es leicht, im Nachhinein mit dem Finger darauf zu zeigen, und der Bereich der Datenwissenschaft in der Großindustrie steckt noch in den Kinderschuhen. Manche würden es einen Wilden Westen der Unterregulierung nennen.

Ich denke, wir können auch froh sein, dass einige konservative Branchen wie das Gesundheitswesen KI für wichtige Entscheidungen noch nicht eingeführt haben. Stellen Sie sich die Folgen vor, wenn sich herausstellen würde, dass ein Melanom-Analysealgorithmus oder ein Amniozentese-Entscheidungsmodell eine rassistische Voreingenommenheit aufweist.

Aus diesem Grund würde ich großen Unternehmen, die Algorithmen freigeben, um wichtige Entscheidungen zu treffen, dringend empfehlen, damit zu beginnen, ein Team von Datenwissenschaftlern auszusondern, deren Aufgabe nicht darin besteht, Algorithmen zu entwickeln, sondern sie Penetrations- und Stresstests zu unterziehen.

Die Datenwissenschaftler, die die Modelle entwickeln, stehen unter zu großem Zeitdruck, als dass sie dies selbst tun könnten, und wie die Cybersicherheitsbranche durch jahrelange Erfahrung herausgefunden hat, ist es manchmal am besten, wenn eine externe Person den Advokaten des Teufels spielt und versucht, Ihr System zu zerstören .

Tauchen Sie ein in die Welt der Natürlichen Sprachverarbeitung! Entdecken Sie modernste NLP-Rollen, die zu Ihren Fähigkeiten und Leidenschaften passen.

NLP-Jobs entdecken

Mittlerweile sind es Organisationen aller Größenordnungen und fast aller Sektoren werden zunehmend datengesteuert, insbesondere als größere Datenspeicher Systeme und schnellere Computer treiben die Leistungsgrenzen immer weiter voran.

Aufgrund des umfangreichen Einsatzes von Technologie und der Arbeitsteilung hat die Arbeit des durchschnittlichen Gig-Economy-Arbeiters jeden individuellen Charakter und damit auch jeden Charme für den Arbeitnehmer verloren.

Die Auswirkungen von KI auf die Humanressourcen Die Arbeitswelt verändert sich rasant, sowohl aufgrund der Einführung traditioneller Data-Science-Praktiken in immer mehr Unternehmen als auch aufgrund der zunehmenden Beliebtheit generativer KI-Tools wie ChatGPT und Googles BARD bei nicht-technischen Arbeitnehmern.

What we can do for you